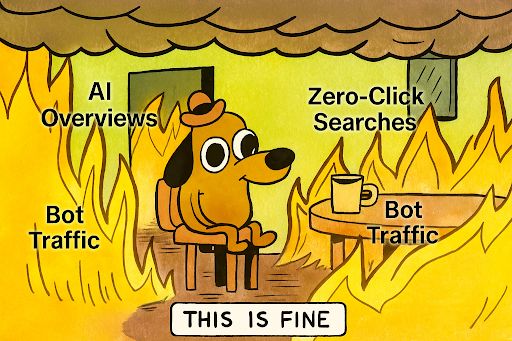

Задали запитання — отримали відповідь прямо в ChatGPT, а сайт-першоджерело так і не відкрили. Це феномен «нульового кліку». Інтернет перетворюється на високорівневий API, а ми — на його користувачів. І як будь-яка нова абстракція в технологіях, цей зсув відкриває не тільки зручність, але й «витоки». Давайте розбиратися.

Від бібліотекаря до API: три епохи взаємодії зі знанням

Ми часто думаємо, що інтернет завжди виглядав так, як зараз. Але насправді наша взаємодія з інформацією йшла сходинками абстракції.

- Епоха бібліотекаря (прямий доступ через посередника). Сто років тому знання було «фізичним». Ми йшли або до експертів, або в бібліотеку, де доступ до даних був опосередкований людиною та її системою — каталогом. 35 років тому з'явився інтернет, але модель залишалася схожою: щоб знайти інформацію, потрібно було знати адреси сайтів або копирсатися в каталогах Yahoo!. Це був ручний доступ до «пам'яті» мережі.

- Епоха асемблера (пошукові системи). Google став «асемблером» цифрового світу. Мова запитів перетворила хаос вебу в керовану систему. Але робота залишалася низькорівневою: пошуковик видавав список посилань, а ми самі грали роль компілятора. Потрібно було відкрити десятки вкладок, порівняти дані, відсіяти сміття і зібрати власний висновок.

- Епоха високорівневого API (генеративний ШІ). З появою LLM (Large Language Models) ми перейшли на новий рівень абстракції. Сьогодні ми формулюємо завдання природною мовою — «Порівняй мені два готелі в Києві» — і «мета-машина» робить усе за нас. Результат готовий за секунди. Для користувача це магія. Але для інтернету — переломний момент: десятки сайтів, на яких базується відповідь, так і не отримали свій клік.

Пролог: довгий шлях до «нульового кліку»

Нульовий клік не з'явився нізвідки. Концепція, за якої користувач отримує вичерпну відповідь, не переходячи на інші сайти, — це те, до чого пошуковики йшли десятиліттями. «Швидкі відповіді» (Featured Snippets), інтерактивні віджети — все це були кроки в одному напрямку. Генеративний ШІ став логічним завершенням цього шляху. Якщо раніше пошуковик показував фрагмент відповіді, тепер він її створює.

Чому наш мозок у захваті

Новий інтерфейс перемагає, тому що ідеально збігається з архітектурою нашого мислення.

- Закон найменшого зусилля (Cognitive Load Theory). Наш мозок завжди мінімізує когнітивні витрати. Старий пошук — десятки вкладок, хаос інформації. Новий — майже нульове навантаження.

- Ефект авторитету (Authority Bias). Ми схильні довіряти впевненим, декларативним твердженням. Кілька досліджень показують значну тенденцію (в низці експериментів — порядку 25–35%) до переоцінки впевнених відповідей ШІ (наприклад, тут, тут і тут).

- Сила наративу. Десять посилань — це набір даних. Відповідь ШІ — це історія. Наш мозок еволюційно заточений сприймати наративи, а не списки.

Іншими словами, ШІ не просто скорочує шлях. Він грає за правилами нашої когнітивної системи, і саме тому поведінка користувачів так швидко змінилася.

Дані підтверджують: зсув уже стався

Дослідження від OpenAI (вересень 2025): майже 48% усіх запитів до ChatGPT потрапляють у категорії «Seeking Information» і «Practical Guidance». Для мільйонів людей ChatGPT уже став прямою заміною пошуку. Google AI Overviews знизили CTR за окремими категоріями запитів на 15–30%. Парадоксально, але CTR за брендованими запитами росте.

Дослідження від OpenAI (вересень 2025): майже 48% усіх запитів до ChatGPT потрапляють у категорії «Seeking Information» і «Practical Guidance». Для мільйонів людей ChatGPT уже став прямою заміною пошуку. Google AI Overviews знизили CTR за окремими категоріями запитів на 15–30%. Парадоксально, але CTR за брендованими запитами росте.

Що це означає? Нейтральні сайти втрачають трафік, а сильні бренди виграють «за замовчуванням» — якщо їх обрав ШІ. Це і є «winner-takes-all» динаміка: маленькі гравці зникають з поля зору, великі закріплюють своє лідерство.

Інтернет як бекенд

То як же саме ШІ перетворює інтернет на свій бекенд? Ключова технологія архітектури сучасних генеративних систем — Retrieval-Augmented Generation (RAG).

То як же саме ШІ перетворює інтернет на свій бекенд? Ключова технологія архітектури сучасних генеративних систем — Retrieval-Augmented Generation (RAG).

У спрощеному вигляді їхня робота виглядає так:

- Користувач ставить запитання (API Call).

- Наприклад: «Порівняй два готелі в Києві».

- Модель робить «запит до бекенду» (Retrieval).

- Замість того щоб відразу видавати відповідь «з голови», система звертається до зовнішніх джерел — власному індексу вебу або пошуковику. У справу йдуть десятки релевантних сторінок: офіційні сайти, відгуки, агрегатори.

- Модель отримує «сирі дані» (Backend Response).

- З них витягуються ключові факти: ціни, рейтинг, перелік послуг, фрагменти відгуків.

- Модель синтезує відповідь (Logic Layer).

- На цьому етапі підключається генеративна частина LLM, перетворюючи зібрані дані на структуровану, зручну для користувача відповідь.

У такій моделі сайти-джерела фактично стають безкоштовними мікросервісами: вони віддають дані, але втрачають прямий контакт з користувачем. Уся «бізнес-логіка» та взаємодія з «фронтендом» (людиною) зміщуються всередину ШІ.

Тому падіння CTR і зростання «нульових кліків» — це не випадковий тренд, а пряме наслідок архітектури RAG.

Важливо: не всі ШІ працюють так. Класичні LLM без доступу до вебу формують відповіді виключно на основі параметрів моделі, без retrieval. Але системи на кшталт Perplexity, ChatGPT з Bing або корпоративні RAG-платформи — саме ті самі «ШІ з інтернетом як бекендом».

«Витоки» нової абстракції

У програмуванні в будь-якої абстракції є «витоки» — моменти, коли прихований шар проривається назовні і приносить проблеми. З генеративним ШІ ситуація рівно така ж.

- Втрата контролю над джерелами (Source Code Blindness). Ми отримуємо гладкий абзац тексту, але не завжди бачимо, на чому він базується. Наприклад, у 2024 році Perplexity.ai кілька разів помилково цитував неіснуючі новини. Ці «факти» розійшлися в соцмережах.

- Атрофія навички критичної перевірки (Automation Bias). Це когнітивне спотворення, за якого людина схильна довіряти машині більше, ніж собі. Дослідження показують, що лікарі та інші спеціалісти не рідко слідують порадам ШІ, навіть коли вони помилкові. Так, недавній препринт фіксує, що використання інструментів LLM підвищує ризик вибору неправильних рішень, якщо модель формулює їх впевнено. Аналогічні результати приводяться і в огляді NEJM AI: пацієнти та лікарі демонструють схильність переоцінювати достовірність відповідей алгоритмів.

- Смерть serendipity (випадкових відкриттів). Раніше пошук був пригодою, аналітичною роботою з можливістю відгалужень і потенціалом для інсайтів. ШІ позбавляє нас цього досвіду. Ми отримуємо рівно те, що попросили — нічого більше.

Нова архітектура можливостей: що ми набуваємо навзамін

Так, ці ризики реальні. Але будь-яка нова потужна абстракція не тільки створює проблеми — вона відкриває доступ до можливостей, які раніше були немислимі. Генеративний ШІ — не виняток, наприклад:

- Демократизація складних знань. Раніше, щоб розібратися в основах квантової фізики або тонкощах корпоративного права, вимагалися роки навчання. Сьогодні ШІ виступає в ролі універсального "перекладача", який може пояснити найскладніші концепції простою мовою. Він робить нішеві, елітарні знання доступними для мільйонів, прискорюючи навчання та інновації.

- Синтез як нове джерело інсайтів. Людський мозок обмежений в обсязі інформації, яку він може одночасно утримувати та аналізувати. ШІ може проаналізувати тисячі наукових статей, звітів і патентів, щоб знайти неочевидні зв'язки та закономірності, які пропустив би будь-який человек. Він дає нам не просто "відповіді", а здатність бачити "ліс за деревами" в масштабах, які раніше були недоступні.

Іншими словами, ми жертвуємо частиною контролю над пошуком, щоб отримати безпрецедентний контроль над синтезом і застосуванням знань. Це не деградація, а перехід на новий рівень роботи з інформацією.

Нова грамотність: робота з «залізом» знань

Ми звикли, що «цифрова грамотність» — це вміння гуглити. Але в реальності грамотність майбутнього — це вміння спускатися на рівень нижче, працювати напряму з джерелами, а не задовольнятися результатом компіляції.

- Для розробників це означає читати документацію API та RFC, а не тільки запитувати в Copilot.

- Для аналітиків — працювати з сирими датасетами, а не обмежуватися саммарі від ChatGPT.

- Для компаній — володіти унікальними «низькорівневими» активами: даними, кейсами, дослідженнями. Усе, що ШІ не може просто «придумати».

Тільки так можна залишатися не споживачем API, а частиною його бекенду.

Саме тому зараз багато говорять про Generative Engine Optimization (GEO) — нову дисципліну, де головна мета не сподобатися пошуковику, а побудувати настільки сильний фундамент з фактів і даних, щоб будь-яка високорівнева модель була змушена посилатися на вас.

Практичні поради: що робити бізнесу та професіоналам

- Зберігайте «низькорівневий доступ». Навіть якщо використовуєте ШІ в щоденній роботі, виділяйте час на перевірку першоджерел. Це знижує ризик помилок і зберігає м'яз критичного мислення.

- Інвестуйте в унікальні дані. Бренди, які володіють оригінальними дослідженнями та датасетами, стають обов'язковим джерелом для ШІ. Це стратегічний актив — як інтелектуальна власність.

- Слідкуйте за «цитуваністю» бренду в ШІ. Новий KPI — не тільки трафік на сайт, але й те, наскільки часто ШІ згадує вас як джерело. Це ранній індикатор майбутньої видимості.

- Розвивайте навички «prompt literacy». Вміння правильно формулювати запити до ШІ — нова цифрова грамотність, подібна до мови програмування 20 років тому.

Замість висновку

Інтернет знову змінює форму, стаючи універсальним API до знань. Але як і з будь-яким API, справжню владу отримує той, хто розуміє архітектуру та керує бекендом.

Питання тепер стоїть так: ви просто споживач цієї «машини відповідей» — чи ви будуєте системи, які цей API буде використовувати як джерело?

Ця стаття була присвячена феномену «нульового кліку».

Коментарі